Il paradosso della verità digitale: l’impresa alla prova dell’Intelligenza Artificiale

Ufficio Marketing e Comunicazione Tutela Legale Spa

In occasione del suo terzo convegno istituzionale, svoltosi lo scorso 6 maggio per celebrare i 56 anni di attività, l’Agenzia Roma Esedra ha riunito esperti e professionisti per una giornata di approfondimento dedicata alle sfide della modernità.

La sessione mattutina ha esplorato le nuove frontiere del welfare e della previdenza, analizzando temi di stretta attualità come la Long Term Care (LTC) e l’assistenza sanitaria, pilastri sempre più centrali per la tenuta del sistema sociale. Sono stati inoltre presentati strumenti innovativi per la previdenza complementare e nuove iniziative dedicate al settore medico, delineando un quadro in cui la tecnologia e la consulenza specialistica si fondono per rispondere ai nuovi bisogni di protezione.

In questo scenario di evoluzione costante, il nostro Direttore Generale Stefano Buraglio, ha tracciato un’analisi sulle implicazioni giuridiche dell’Intelligenza Artificiale, spostando l’attenzione dall’entusiasmo per l’innovazione alla concretezza della responsabilità d’impresa.

L’erosione del concetto di prova

Il punto di partenza è un mutamento antropologico, prima ancora che tecnologico: la fine della certezza documentale. Per decenni, il sistema giudiziario ha poggiato sulla solidità delle prove visive e auditive. Oggi, l’avvento dell’IA generativa ha reso la manipolazione della realtà — i cosiddetti deepfake — un’operazione economica e alla portata di chiunque.

Questo scenario introduce un rischio sottile che alcuni giuristi definiscono “Liar’s Dividend”: in un mondo in cui tutto può essere contraffatto, il colpevole di un reato reale può paradossalmente difendersi sostenendo che la prova a suo carico sia un prodotto dell’IA. Questa “evaporazione” della verità oggettiva rappresenta la prima, grande sfida per la difesa legale delle aziende.

L’imprenditore come garante: il cambio di paradigma dell’EU AI Act

L’analisi di Buraglio si è poi spostata sul quadro normativo europeo. L’EU AI Act introduce un concetto cardine: l’Accountability. La responsabilità legale non ricade più esclusivamente su chi sviluppa la tecnologia (il provider), ma si sposta in modo deciso su chi la utilizza nei propri flussi di lavoro (il deployer).

L’imprenditore che adotta sistemi automatizzati per la selezione del personale, per la valutazione del credito o per l’interazione con i clienti, ne diventa il garante legale. Non è più possibile appellarsi all’oscurità dell’algoritmo; la norma richiede una “AI Literacy”, ovvero una consapevolezza critica degli strumenti adottati, poiché le sanzioni e le responsabilità civili colpiscono direttamente il bilancio aziendale.

Le nuove frontiere del danno aziendale

I fronti di scontro sono già aperti. Buraglio ha elencato diverse fattispecie di rischio:

- Le “allucinazioni” contrattuali: una chatbot che promette condizioni non previste crea un’obbligazione contrattuale vincolante per l’azienda.

- La sovranità del dato: l’immissione di informazioni riservate in IA pubbliche comporta la perdita del controllo sul segreto industriale, con violazioni che si sommano a quelle del GDPR.

- Il Deepfake aziendale: l’uso di audio clonati per ordinare bonifici fraudolenti o danneggiare la reputazione del brand attraverso contenuti falsi ma verosimili.

La difesa tecnica e peritale

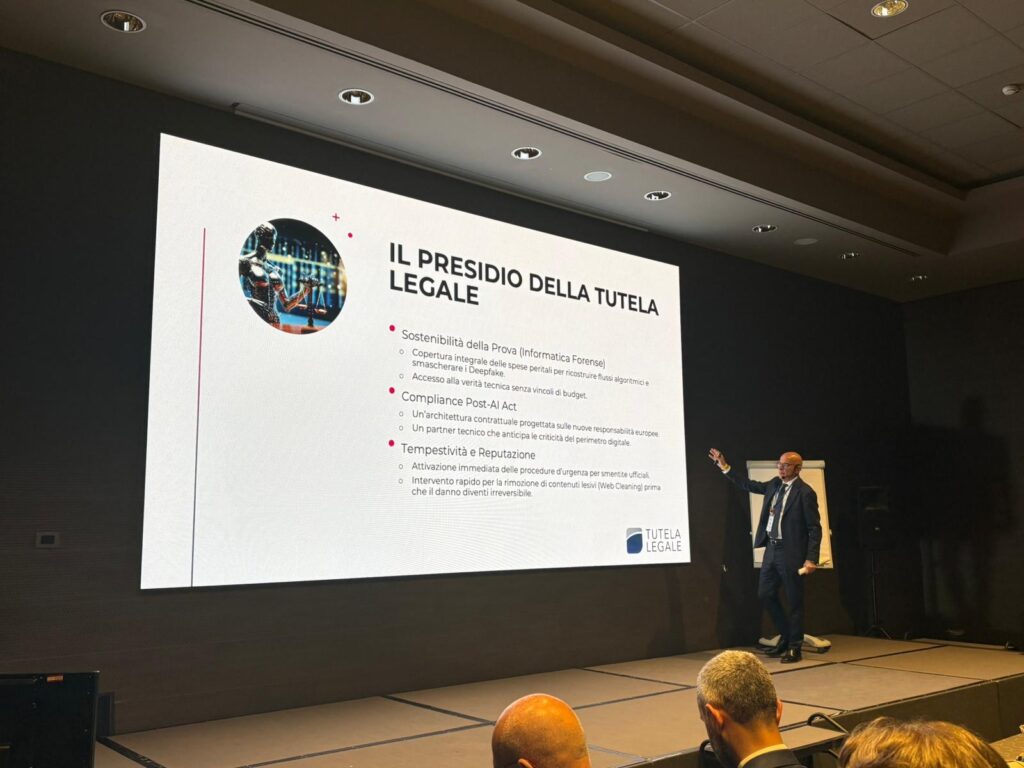

In questo labirinto di responsabilità, la funzione della Tutela Legale evolve. La difesa di un’impresa coinvolta in controversie legate all’IA non può più limitarsi alla sola assistenza legale tradizionale. Diventa fondamentale il supporto dell’informatica forense.

“La partita giuridica si vince sul terreno tecnico” ha sottolineato Buraglio. È necessario poter schierare periti capaci di analizzare metadati, ricostruire flussi algoritmici e dimostrare scientificamente la natura manipolata di un file. La missione della Compagnia è proprio garantire all’imprenditore la sostenibilità economica di questa difesa specialistica, permettendogli di scegliere i migliori professionisti senza che il budget diventi un ostacolo alla ricerca della verità.

Conclusioni

Gestire l’intelligenza artificiale non significa frenare l’innovazione, ma governare i suoi limiti. L’IA non possiede una morale né un patrimonio da difendere; l’imprenditore, al contrario, risponde di ogni processo automatizzato messo in campo. In un mercato che corre veloce, la solidità della tutela legale è l’unica garanzia per far sì che il progresso tecnologico non si trasformi in un’insidia per la continuità aziendale.